AI in Energiemanagement: waarom wij denken dat rule-based EMS plaats gaat maken voor Deep Reinforcement Learning

De energietransitie heeft de markt fundamenteel veranderd. Niet de vraag, maar het weer dicteert inmiddels de stroomprijs. Zonnige middagen veroorzaken overschotten en netcongestie, terwijl zonsondergang juist leidt tot schaarste en prijspieken. Voor bedrijven met assets zoals zonnepanelen, batterijen en laadpalen biedt deze volatiliteit enorme kansen voor handelen. Maar die kansen brengen ook risico’s met zich mee voor de netaansluiting en bedrijfszekerheid. Om succesvol in deze complexe dataomgeving te sturen, loopt traditionele ‘rule-based’ software nu tegen zijn limieten aan.

Waarom rule-based EMS tekortschiet in een dynamische energiemarkt

Wat we tot voor kort zagen, was dat energiemanagement relatief overzichtelijk was. Een traditioneel (rule-based) Energie Management Systeem (EMS) werkt op basis van simpele, door mensen geprogrammeerde ‘als-dan’-regels. Bijvoorbeeld: “Als de stroomprijs hoog is, ontlaad dan de batterij” of “Als de zonnepanelen leveren, zet dan de laadpalen aan.” Dit is transparant en werkt uitstekend voor simpele processen.

Maar we zien dat de realiteit achter de meter inmiddels een stuk complexer is. Wat moet de software doen als de zon schijnt en de stroomprijs negatief is, maar de zware machines onverwacht opstarten en het wagenpark over een uur vol moet zijn?

Voor elke denkbare uitzondering of weersverandering moet een programmeur handmatig een nieuwe regel toevoegen. In de praktijk zien we dat de software hier tegen drie fundamentele beperkingen aanloopt:

- Veiligheidsmarges verlagen rendement: De praktijk is onvoorspelbaar. Omdat het onmogelijk is om voor elke unieke samenloop van omstandigheden (prijzen, weer, lokaal verbruik) een perfecte regel te schrijven, dwingt dit ontwerpers om te werken met brede veiligheidsmarges. Het systeem houdt bijvoorbeeld altijd een groot deel van de batterij vol voor de zekerheid. Fijn voor de bedrijfszekerheid, maar vaak totaal onnodig en dus loopt de batterij onnodig inkomsten mis.

- Geen adaptief leervermogen: De software doet uitsluitend wat een mens heeft voorgeprogrammeerd. Het ontdekt zelf geen nieuwe correlaties tussen weersvoorspellingen, verbruikspieken en marktbewegingen. En dat is een probleem, want de markt verandert razendsnel en kan er door beslissingen van bijvoorbeeld TenneT of de overheid morgen opeens heel anders uitzien.

- Onwerkbare operationele onderhoudslast: Elke bedrijfslocatie is uniek qua netaansluiting, batterijcapaciteit en verbruiksprofiel. Een rule-based systeem vereist voor elke nieuwe installatie handmatige kalibratie van de regels. Wat op locatie A werkt, is niet overdraagbaar naar locatie B. Dit maakt opschaling inefficiënt en duur.

Deze beperkingen brachten ons tot een belangrijk inzicht: om ultieme schaalbaarheid te bereiken - én de beste performance voor onze klanten te garanderen - moeten we verder kijken dan traditionele voorspellingen en optimalisaties. Zo kwamen wij uit bij (Deep) Reinforcement Learning. Veel mensen geven dit direct het populaire label ‘AI’, maar daar zijn wij nog voorzichtig mee.

Integrale sturing met Deep Reinforcement Learning (DRL)

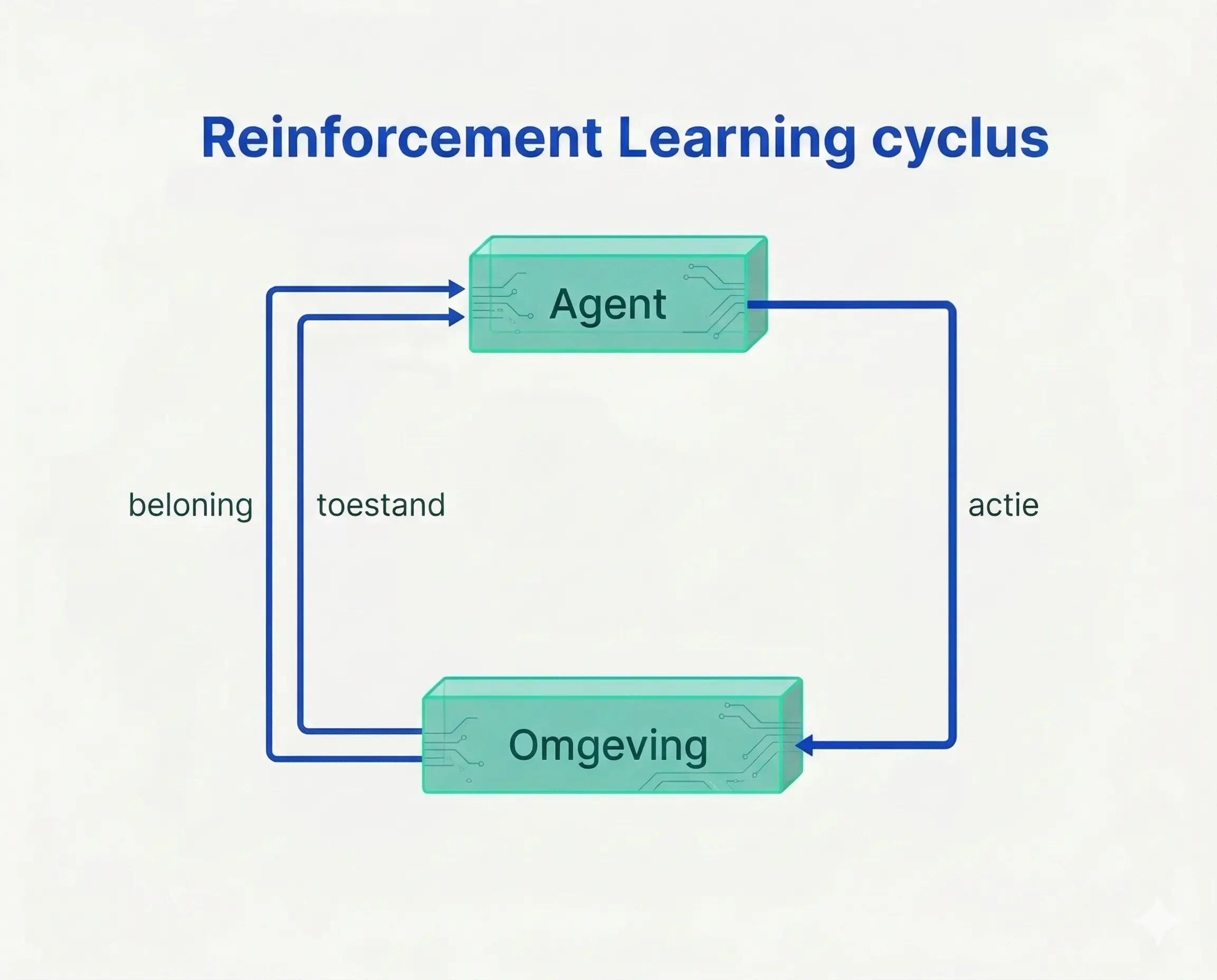

Deep Reinforcement Learning (DRL) is voor ons namelijk interessant, omdat het de tekortkomingen van rule-based systemen oplost door een compleet andere benadering: het leert door interactie met de omgeving. In plaats van starre regels te volgen, neemt een virtuele ‘agent’ beslissingen, observeert de uitkomst en ontvangt een beloning voor goede resultaten - zoals hogere handelswinst of beter peakshaven. Door middel van trial-and-error in een veilige, virtuele simulatie ontdekt de agent zelfstandig welke strategieën op lange termijn het beste werken.

Een DRL-algoritme ontdekt razendsnel complexe relaties, óók degene die voor het menselijk oog verborgen blijven. Dat maakt deze technologie zo krachtig.

Wij trainen het model in een simulatie van de werkelijkheid. Tijdens dit trainingsproces ontvangt de agent een beloning als deze winst maakt, en een strafpunt bij verlies. Bij het bepalen van de volgende actie verwerkt het algoritme direct alle relevante actuele data, zoals weers- en marktvoorspellingen. Deze voorspellingen bevatten altijd onzekerheden. Waar een star rule-based systeem vaak vastloopt op die onvoorspelbaarheid, leert een DRL-agent in de simulatie juist perfect anticiperen op deze onzekerheidsmarges. Hierdoor leert de agent bijvoorbeeld dat een specifieke combinatie van zonkracht, verwachte prijspieken én de foutmarge in het weersbericht, de optimale conditie is voor een actie. Door deze simulatie miljoenen keren te doorlopen, leert het algoritme steeds beter datapatronen te herkennen en ontdekt het welke acties leiden tot het beste resultaat.

Hierdoor verdwijnen de brede, inefficiënte veiligheidsmarges, past het systeem zich automatisch aan bij veranderend verbruiksgedrag en is opschaling naar nieuwe locaties veel makkelijker omdat handmatige kalibratie vervalt.

Voor de zekerheid: hoewel dit onder de brede paraplu van ‘AI’ valt, hebben we het hier nadrukkelijk niet over modellen als ChatGPT of Claude die autonoom onvoorspelbare beslissingen nemen. We spreken hier over een specifieke agent die wij zelf trainen en die uitsluitend keuzes maakt aan de hand van de harde data, actuele voorspellingen en de afgekaderde fysieke omgeving.

Vooruitblik: Operationele veiligheid en controle over AI

Het huidige energielandschap is inmiddels te complex en dynamisch voor traditionele rule-based systemen. Zeker wanneer je daar alle lokale afwegingen - zoals specifieke energiebelastingen en netbeheerkosten - bij optelt. Deep Reinforcement Learning (DRL) biedt een krachtig alternatief: het stelt een EMS in staat om zelfstandig te leren, verborgen patronen te ontdekken en direct in te spelen op veranderende marktomstandigheden en lokaal verbruik. Echter, het inzetten van zelflerende algoritmes voor het aansturen van kritieke, fysieke infrastructuur (zoals een zware bedrijfsaansluiting) roept belangrijke ontwerpvragen op.

Hoe garandeer je dat een algoritme dat continu zoekt naar beloningen nooit operationele risico’s neemt die de netaansluiting in gevaar brengen? En omdat een DRL-model normaal gesproken een gesloten systeem is: hoe zorg je dat het in de praktijk toch veilig communiceert met de software van externe partijen?

Deel 2 van deze reeks behandelt het transparant maken van de ‘zwarte doos’ van AI in energiemanagement, het veilig begrenzen van DRL-systemen en het daarmee behouden van controle over de bedrijfszekerheid.

Klaar om jouw energie Zympler te maken? Neem direct contact op voor een demo of intake.

Wil jij je klant helpen met slim energie management? Word partner van Zympler.

Eerst nog meer weten of een vraag? We horen graag van je.